[라이트 머신러닝]Session 7. 로지스틱 회귀(logistic regression)

이전까지 설명했던 퍼셉트론 알고리즘은 간단하고 좋지만 클래스가 선형적으로 구분되지 않을 때는 수렴하지 않습니다. 따라서, 더 강력한 알고리즘 로지스틱 회귀를 설명하려고 합니다. 이름은 회귀지만 사실은 분류 알고리즘임을 잊지마세요!

1. 로지스틱 회귀의 이해와 조건부 확률

먼저, 오즈비(odds ratio)를 소개하도록 하겠습니다. 오즈는 특정한 상황이 발생활 확률로, 그림 1과 같은 수식을 갖습니다. 여기서 P는 예측할 대상, 양성 샘플을 의미합니다. 여기에 로그 함수를 취하면 로짓(logit)함수가 됩니다.

여기서의 로그는 예상하셨듯 자연로그입니다. logit함수는 0에서 1사이의 값을 입력받아서 실수 범위의 값으로 변환합니다. 가중치 w로 표현되었던 앞선 함수를 기억하시나요? 특성 가중치 합과 로그 오즈 사이의 관계는 아래와 같이 쓰입니다. 여기서 P(y=1|x) 는 특성 x가 있을 때 이 샘플이 클래스(y) 1에 속할 조건부 확률입니다.

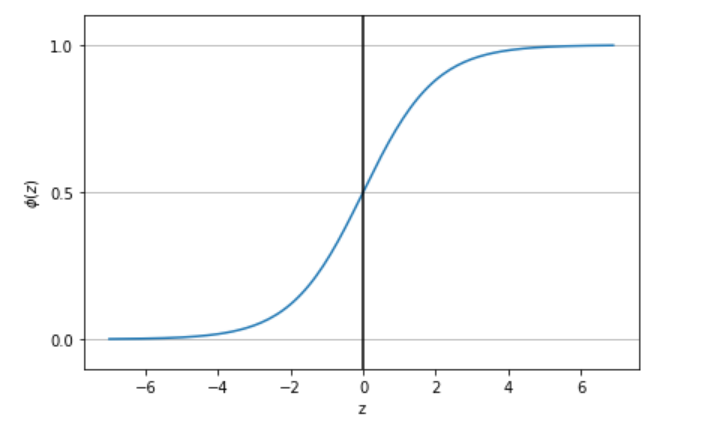

하지만 우리는 어떤 샘플이 특정 클래스에 속할 확률을 예측하는 것을 바라니 logit 함수를 거꾸로 뒤집습니다. 확률은 분수니까요! 이 함수를 로지스틱 시그모이드 함수(logistic sigmoid function), 줄여서 시그모이드 함수(sigmoid function)이라고 부릅니다.

z는 최종입력, 즉 w^Tx가 됩니다. 아래 코드는 시그모이드 함수가 어떻게 생겼는지를 직접 그려보는 코드로, -7부터 7까지 그려보도록 하겠습니다.

import matplotlib.pyplot as plt

import numpy as np

def sigmoid(z):

return 1.0 / (1.0 + np.ezp(-z)

z = np.arange(-7, 7, 0.1)

phi_z = sigmoid(z)

plt.plot(z, phi_z)

plt.axvline(0.0, color = 'k')

plt.ylim(-0.1, 1.1)

plt.xlabel('z')

plt.yticks([0.0, 0.5, 1.0])

ax = plt.gca()

ax.yaxis.grid(True)

plt.tight_layout()

plt.show()

코드를 실행하면 S자 형태의 시그모이드 곡선을 확인할 수 있습니다. x축을 담당하는 z가 무한대에 가까워질수록 e^(-z)의 값은 작아지기 때문에 시그모이드는 1에 가까워집니다. 비슷하게 z가 음의 무한대로 가까워질수록 e^(-z)의 값은 커지기 때문에 시그모이드는 0에 수렴하게 됩니다. 따라서 이 시그모이드 함수는 입력을 0과 1 사이의 값으로 변환하게 됩니다.

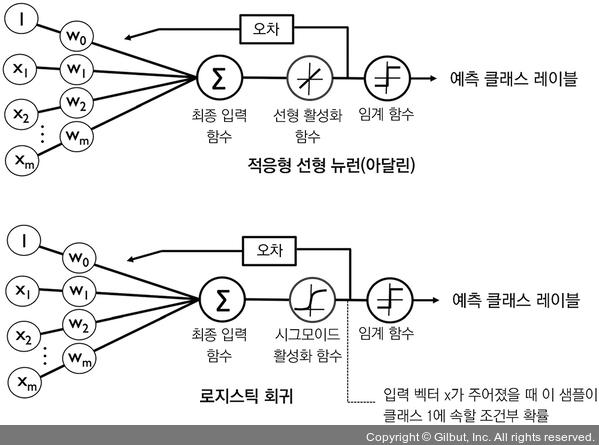

여러분 모두 앞에서 언급한 아달린을 기억하시나요? 로지슽틱 회귀 모델을 아달린과 비교해보도록 하겠습니다.

위 그림에서 확인할 수 있다시피 아달린은 선형 활성화 함수를 최종입력과 임계함수 사이에 썼지만, 로지스틱 회귀는 선형 활성화 함수 자리에 시그모이드 활성화 함수를 적용합니다. 시그모이드 함수의 결과로 입력이 클래스 1에 속할 조건부 확률이 출력되고, 이후 오차가 돌아가 가중치를 업데이트 합니다.

여기서 입력이 클래스 1에 속할 조건부 확률이 ∮(z) = P(y=1|x;w)로 해석됩니다. 만약에 어떤 샘플이 ∮(z) = 0.3이라면 샘플이 클래스 1에 속할 확률이 30%라는 뜻이죠. 반대로 클래스 2일 확률은 70%가 되죠. 예측 확률인 y hat은 다음과 같이 정리할 수 있습니다.

이 모양은 아달린의 임계 함수에서 확인할 수 있는 것과 유사하며, 시그모이드 함수 그래프와 동일함을 확인할 수 있습니다.

로지스틱 회귀는 비가 올지, 오지 않을지를 예측하는 것 뿐만 아니라 비가 올 확률을 예측해야하는 경우에도 사용할 수 있습니다. 비슷하게는 특정 증상이 있는 환자가 특정 질병을 가질 확률을 예측하는데에도 사용할 수 있습니다.

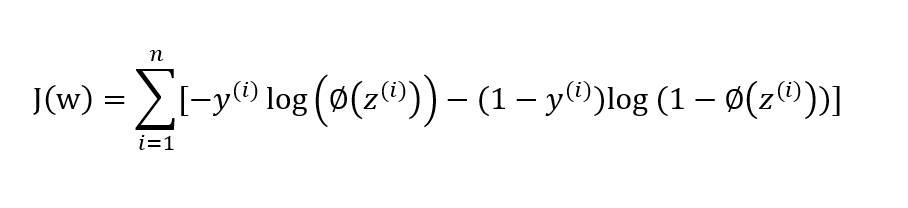

3. 로지스틱 비용 함수의 가중치 학습

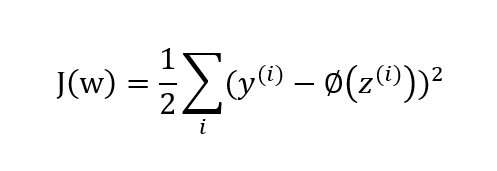

이제 가중치 w의 학습 방법에 대해서 알아보도록 하겠습니다. 앞에서 쓰인 제곱 오차합 함수를 기억하시나요? 아래와 같은 함수였습니다.

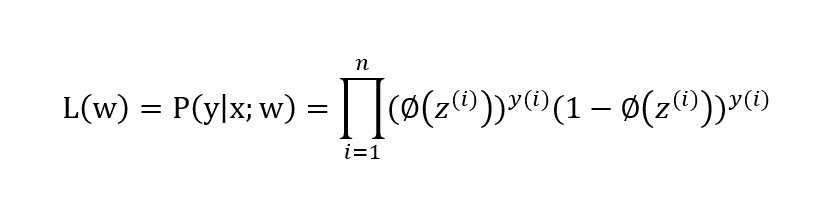

아달린 분류 모델에서는 이 함수를 최소화하는 가중치 w를 학습했습니다. 로지스틱의 경우에는 모델을 만들 때 최대화하려는 기능 L(likelihood)을 정의합니다. 공식은 다음과 같습니다.

실전에서는 가능도가 낮을 때 일어나는 언더플로를 미연에 방지할 수 있고, 계수의 곱을 계수의 합으로 바꿔쓸 수 있는 자연로그를 최대화하는 것이 더 쉽습니다. 이 함수를 로그 가능도 함수라고 부릅니다.

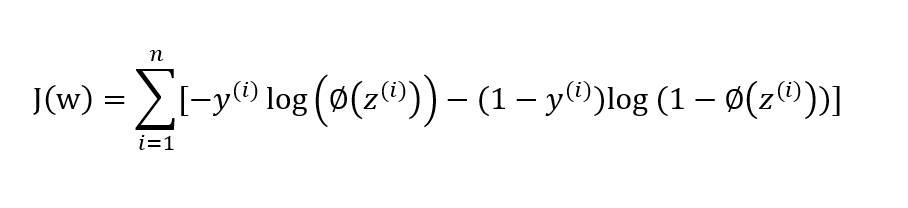

경사 상승법 같은 최적화 알고리즘을 통해 로그 기능도 함수를 최대화하거나 로그 기능도 함수를 다시 비용함수인 J로 표현해 경사하강법을 이용해 최소화할 수도 있습니다.

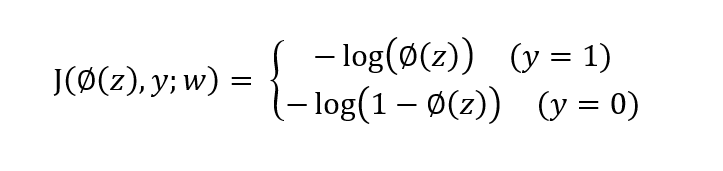

이 비용함수를 이해하기 위해서 샘플이 하나일 때 비용을 계산해보도록 하겠습니다. 이 식을 보면 y = 0일 때 첫째 항이 0이 되고, y = 1일 때는 둘째 항이 0이 됩니다.

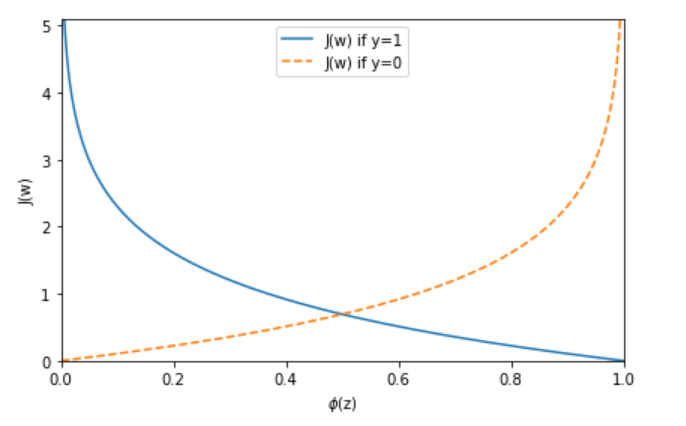

간단한 코드를 통해서 샘플이 하나인 경우에 ∮(z) 값에 따른 분류 비용을 그려보도록 하겠습니다.

def cost_1(z):

return - np.log(sigmoid(z))

def cost_0(z):

return - np.log(1 - sigmoid(z))

z = np.arange(-10, 10, 0.1)

phi_z = sigmoid(z)

c1 = [cost_1(x) for x in z]

plt.plot(phi_z, c1, label='J(w) if y=1')

c0 = [cost_0(x) for x in z]

plt.plot(phi_z, c0, linestyle='--', label='J(w) if y=0')

plt.ylim(0.0, 5.1)

plt.xlim([0, 1])

plt.xlabel('$\phi$(z)')

plt.ylabel('J(w)')

plt.legend(loc='best')

plt.tight_layout()

plt.show()

클래스 1에 속한 샘플을 정확하게 예측하면 비용이 0에 수렴하는 것을 확인할 수 있습니다.(파란색 실선) 클래스 0에 속한 샘플을 정확하게 예측하면 마찬가지로 비용이 0에 수렴하는 것도 확인할 수 있죠.(노란색 점선) 예측이 잘못되면 비용은 무한대로 발산합니다. 잘못된 예측에는 그에 따른 더 큰 비용이 부여되는 것입니다.

3. 아달린 구현을 로지스틱 회귀 알고리즘으로 바꾸기

앞 세션에서 구현한 아달린에 로지스틱 회귀 알고리즘을 적용하기 위해서는 비용함수만 대체해주면 됩니다.

요 그림 11에 나온 비용함수를 재사용하도록 하겠습니다. 이 함수로 에포크마다 훈련샘플을 분류하는 비용을 계산합니다. 그리고 선형 활성화 함수를 시그모이드 함수로 대체하고, 임계 함수가 클래스 1과 -1이 아닌 0과 1을 반환하도록 변경하면 됩니다. 코드는 아래와 같습니다.

class LogisticRegressionGD(object):

"""경사 하강법을 사용한 로지스틱 회귀 분류기

매개변수

------------

eta : float

학습률 (0.0과 1.0 사이)

n_iter : int

훈련 데이터셋 반복 횟수

random_state : int

가중치 무작위 초기화를 위한 난수 생성기 시드

속성

-----------

w_ : 1d-array

학습된 가중치

cost_ : list

에포크마다 누적된 로지스틱 비용 함수 값

"""

def __init__(self, eta=0.05, n_iter=100, random_state=1):

self.eta = eta

self.n_iter = n_iter

self.random_state = random_state

def fit(self, X, y):

"""훈련 데이터 학습

매개변수

----------

X : {array-like}, shape = [n_samples, n_features]

n_samples 개의 샘플과 n_features 개의 특성으로 이루어진 훈련 데이터

y : array-like, shape = [n_samples]

타깃값

반환값

-------

self : object

"""

rgen = np.random.RandomState(self.random_state)

self.w_ = rgen.normal(loc=0.0, scale=0.01, size=1 + X.shape[1])

self.cost_ = []

for i in range(self.n_iter):

net_input = self.net_input(X)

output = self.activation(net_input)

errors = (y - output)

self.w_[1:] += self.eta * X.T.dot(errors)

self.w_[0] += self.eta * errors.sum()

# 오차 제곱합 대신 로지스틱 비용을 계산합니다.

cost = -y.dot(np.log(output)) - ((1 - y).dot(np.log(1 - output)))

self.cost_.append(cost)

return self

def net_input(self, X):

"""최종 입력 계산"""

return np.dot(X, self.w_[1:]) + self.w_[0]

def activation(self, z):

"""로지스틱 시그모이드 활성화 계산"""

return 1. / (1. + np.exp(-np.clip(z, -250, 250)))

def predict(self, X):

"""단위 계단 함수를 사용하여 클래스 레이블을 반환합니다"""

return np.where(self.net_input(X) >= 0.0, 1, 0)

# 다음과 동일합니다.

# return np.where(self.activation(self.net_input(X)) >= 0.5, 1, 0)

여기서 구현된 로지스틱 모델은 오직 이진 분류 문제에만 적용가능합니다. 따라서 다중 분류 문제에는 적용할 수 없다는 것입니다. 클래스 1과 0만을 갖고있기 때문이죠. 붓꽃 데이터 두 개를 가지고 로지스틱 회귀 구현이 잘 돌아가는지 확인하도록 하겠습니다.

X_train_01_subset = X_train[(y_train == 0) | (y_train == 1)]

y_train_01_subset = y_train[(y_train == 0) | (y_train == 1)]

lrgd = LogisticRegressionGD(eta=0.05, n_iter=1000, random_state=1)

lrgd.fit(X_train_01_subset,

y_train_01_subset)

plot_decision_regions(X=X_train_01_subset,

y=y_train_01_subset,

classifier=lrgd)

plt.xlabel('petal length [standardized]')

plt.ylabel('petal width [standardized]')

plt.legend(loc='upper left')

plt.tight_layout()

plt.show()

4. 사이킷런을 이용한 로지스틱 회귀 모델 훈련

앞에서 아달린과 로지스틱 회귀의 차이점에 대해서 공부했으니, 이번에는 사이킷런에서 로지스틱 회귀를 사용하는 방법을 알아볼까요? 이번에는 위 코드와 다르게 다중 분류도 지원합니다. 아래 코드에서 sklearn.linear_model.LogisticRegression의 fit 메서드를 통해 표준화된 클래스 세 개를 대상으로 모델을 훈련하도록 하겠습니다.

from sklearn.linear_model import LogisticRegression

lr = LogisticRegression(solver='liblinear', multi_class='auto', C=100.0, random_state=1)

lr.fit(X_train_std, y_train)

plot_decision_regions(X_combined_std, y_combined,

classifier=lr, test_idx=range(105, 150))

plt.xlabel('petal length [standardized]')

plt.ylabel('petal width [standardized]')

plt.legend(loc='upper left')

plt.tight_layout()

plt.show()

훈련 데이터 모델은 훈련하고 그리면 그림 15와 같이 결정경계를 선명하게 확인할 수 있습니다. 여러분은 아직 위 코드의 'C' 라는 매개변수를 잘 모르시겠지만, 이건 다음 5번에서 설명드릴 수 있을 것 같습니다. 이 바로 다음에는 overfitting과 규제에 대해서 소개하게 될테니까요.

훈련 샘플이 어떤 클래스에 속할 확률은 predict_proba 메서드를 이용해서 예측할 수 있습니다.

lr.predict_proba(X_test_std[:3,:])

위 코드는 그림과 같은 배열을 반환합니다. 첫 번째 행은 첫 번째 붓꽃 클래스의 소속 확률이고, 두 번째 행은 두 번째 꽃의 클래스 소속 확률을 나타냅니다. 모든 열을 더하면 당연히 확률의 합이므로 1이 되겠죠? 첫 번째 행에서 가장 큰 값은 0.855 정도입니다. 이것은 첫 번째 꽃이 클래스 3에 소속될 확률이 85.5% 라는 뜻입니다. 여기서 유추할 수 있듯이, 각 행에서 가장 큰 값이 예측 클래스 레이블이 됩니다. 넘파이 함수인 argmax를 사용하면 아래와 같습니다.

lr.predict_proba(X_test_std[:3, :]).argmax(axis=1)

#array([2,0,0])

lr.predict(X_test_std[:3, :])

#array([2,0,0])

lr.predict(X_test_std[0,:].reshape(1, -1))

#array([2])

실행하면 array([2, 0, 0]) 이 출력됩니다. 두 번째 줄과 같이 조금 더 간단하게 직접 predict 함수를 호출하여도 빠르게 확인할 수 있습니다. 마지막으로 샘플 하나의 클래스 레이블을 예측할 때 주의할 점은, 사이킷런은 입력 데이터로 2차원 배열을 요구하므로, 하나의 행을 2차원 포맷으로 변경해야한다는 점입니다. 세 번째 줄처럼 reshape 메서드를 사용하면 쉽게 새로운 차원을 추가할 수 있습니다.

5. 규제를 사용하여 과대적합 피하기

과대적합은 앞선 세션에서도 몇 번 언급된 overfitting으로, 머신 러닝에서 자주 발생하는 문제입니다. 모델이 훈련 데이터로는 잘 동작하지만 테스트 데이터에서는 정확도가 많이 떨어지는 현상입니다. 우리는 모델의 과대적합될 때 분산이 크다고 말합니다.

비슷하게 모델이 과소적합, 즉 underfitting일 때도 있습니다. 훈련 데이터에 있는 패턴을 감지할 정도로 모델이 복잡하지 않다는 의미입니다. 아래 그림 16의 결정경계를 통해서 쉽게 설명할 수 있습니다.

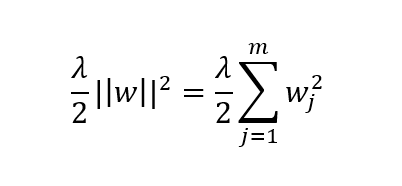

그림에서 볼 수 있는 좋은 절충점을 찾는 한 가지 방법은 규제(regularization)을 이용해서 모델의 복잡도를 조정하는 것입니다. 규제는 공선성(collinearity), 즉 특성간의 상관관계를 다루거나 데이터의 잡음을 제거하는 유용한 방법입니다. 과도한 가중치 값을 제한하기 위해서 추가적인 정보인 편향을 주입하는 개념이죠. 가장 많이 쓰이는 규제는 L2규제(다른 말로 L2축소 또는 가중치 감쇠)입니다.

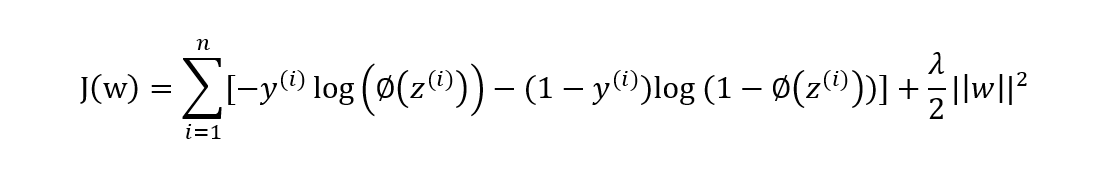

이 식에서 람다는 규제 하이퍼파라미터를 의미합니다. 로지스틱 회귀에서 비용함수는 규제 항을 추가해서 적용합니다. 식은 아래와 같습니다.

람다를 사용해 가중치를 작게 유지하면서 훈련데이터에 맞추는 정도를 조정할 수 있습니다. 분수식에서 확인할 수 있듯이 람다값이 증가하면 규제의 강도도 높아지죠.

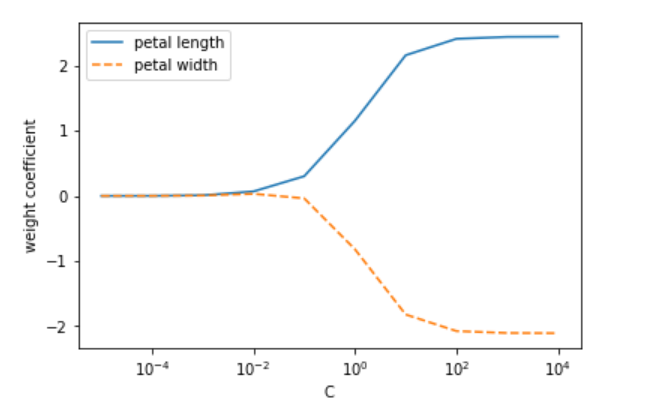

위에서 궁금했던 매개변수 'C' 는 규제 하이퍼 파라미터인 람다의 역수입니다. 따라서 C값을 감소시키면 규제강도가 증가하는 것이죠. 이 과정에서 L2 규제 효과를 그래프로 보도록 하겠습니다.

weights, params = [], []

for c in np.arange(-5, 5):

lr = LogisticRegression(solver='liblinear', multi_class='auto', C=10.**c, random_state=1)

lr.fit(X_train_std, y_train)

weights.append(lr.coef_[1])

params.append(10.**c)

weights = np.array(weights)

plt.plot(params, weights[:, 0],

label='petal length')

plt.plot(params, weights[:, 1], linestyle='--',

label='petal width')

plt.ylabel('weight coefficient')

plt.xlabel('C')

plt.legend(loc='upper left')

plt.xscale('log')

plt.show()

이 코드를 통해 그림 19의 그래프를 그릴 수 있습니다. 결과 그래프에서 확인할 수 있듯이 C가 감소하면 가중치 절댓값이 줄어듭니다, 즉 규제 강도가 증가하는 것이죠.

이번 세션에서는 로지스틱 회귀에 대해서 알아보았습니다. 동시에 중요한 개념인 overfitting, underfitting 그리고 규제(regularization)을 다루었습니다. 로지스틱 회귀 알고리즘은 제가 처음 머신러닝을 유튜브 <모두를 위한 머신러닝>으로 배울 때 극 초반에 배웠던 내용이기도 하고, 실제로도 자주 쓰이는 모델입니다. 저는 아달린과 퍼셉트론은 이번에 처음 들어본 개념이었는데, 로지스틱 회귀는 유명해서 알고 있었거든요. 정말 많이 쓰이는 분류 모델을 배운 것을 축하드립니다! 다음 세션에서 최대 마진 분류와 비선형 문제를 들고 찾아오도록 하겠습니다.